人工智能已经把文字提示变成了令人惊叹的艺术。下一步:视频

Runway已经放弃了中途和稳定的扩散,推出了第一个从文本到视频的人工智能艺术片段,该公司表示,这些片段完全由文本提示生成。

该公司表示,它正在为其首个使用真实世界场景作为模型的更简单的文本到视频工具提供类似的等待名单,以加入它所称的文本到视频人工智能的“第二代”。

当人工智能艺术去年出现时,它使用了文本到图像的模式。用户将输入描述场景的文本提示,该工具将尝试使用它所知道的真实世界的“种子”、艺术风格等来创建图像。中途旅行等服务在云服务器上执行这些任务,而稳定扩散和稳定部落则利用了在家用PC上运行的类似人工智能模型。

然而,文本到视频是下一步。有很多方法可以做到这一点:Pollinations.ai积累了几个你可以尝试的模型,其中一个只是取几个相关的场景,并将它们串在一起构成一个动画。另一款只需创建一个图像的3D模型,并允许您进行缩放。

Runway采取了一种不同的方式。该公司已经提供了人工智能支持的视频工具:从视频中移除对象的修复(而不是图像)、人工智能支持的bokeh、脚本和字幕等。它的第一代文本到视频工具允许你构建一个真实世界的场景,然后将它作为一个模型,在它上面叠加一个文本生成的视频。这通常是以图像的形式进行的,例如,你可以拍摄一张金毛猎犬的照片,然后使用人工智能将照片转换为杜宾犬的照片。

这是第一代。正如该公司在推特上所说,Runway的第二代可以使用现有的图片或视频作为基础。但这项技术也可以完全从文本提示符中自动生成短视频剪辑。

只需文字即可生成视频。如果你能说出来,现在你就能看到它。

简介,文本到视频。与第二代人一起。

正如Runway的推文所指出的那样,这些片段都很短(最多只有几秒钟),非常粗糙,而且帧速率很低。目前也不清楚Runway将于何时发布该模型,以供早期访问或一般访问。但Runway Gen 2页面上的示例确实显示了各种各样的视频提示:纯文本到视频的AI、文本+图像到视频等等。似乎你给模型的投入越多,你的运气就越好。在现有的物体或场景上叠加视频似乎可以提供最流畅的视频和最高的分辨率。

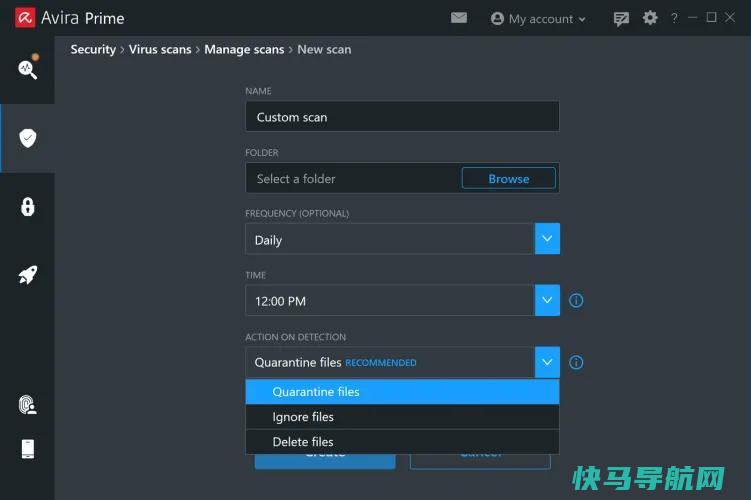

Runway已经提供了12美元/月的“标准”计划,允许无限制的视频项目。但某些工具,比如实际训练你自己的肖像或动物生成器,需要额外支付10美元的费用。目前还不清楚Runway将对其新车型收取多少费用。

然而,Runway展示的是,在短短几个月内,我们已经从文本到图像的人工智能艺术转变为文本到视频的人工智能艺术…我们所能做的就是惊讶地摇头。

外链关键词: 边宁学历东风 青海老师学历名单 餐饮企业成本核算方法 夜场美女 三省六部品牌 民国南京地图 计算机水平考试成绩 逍飞学历本文地址: https://www.q16k.com/article/aa64e948de2c2c973a04.html

用户中心

用户中心